一年前,通过前沿研究,微软正式发布了 Phi-3 模型家族,首次推出了小语言模型(SLM),为用户带来了更多高效的 AI 模型与工具选择。

现在,Phi-4-reasoning、Phi-4-reasoning-plus和Phi-4-mini-reasoning推理模型家族正式发布。这不仅开启了小语言模型的新纪元,也再次刷新了小型高效 AI 的能力上限。

推理模型:迈向更高层次智能

「推理模型」专为推理阶段的算力扩展而优化,能够胜任需要多步拆解和自身反思的复杂任务,尤其在数学推理领域表现突出。

如今,推理模型正在逐步成为应对多层次复杂任务的 AI 智能体框架基础。以往,只有规模较大的前沿模型才具备这样的能力。而 Phi 推理模型的出现,开创了小语言模型的新范式。

依托高质量数据集、知识蒸馏和强化学习等技术,这些模型巧妙地平衡了体积与性能。它们不仅足够精巧,适用于低延迟环境,还具备媲美更大模型的强大推理能力——让资源有限的设备也能高效应对复杂推理任务。

Phi-4-reasoning 与 Phi-4-reasoning-plus

Phi-4-reasoning

Phi-4-reasoning是一款拥有 140 亿参数、开放权重的推理模型。它能够在复杂推理任务中,与主流大模型一较高下。

该模型通过对 Phi-4 进行有监督微调,精心采集了 OpenAI o1-mini 的高质量推理示例,从而实现了多步推理链的自动生成,充分挖掘了推理阶段可用的计算资源。

Phi-4-reasoning的成功,证明了只要数据精细、合成数据集质量足够高,小型模型同样有能力与更大规模的模型竞争。

Phi-4-reasoning-plus

Phi-4-reasoning-plus在Phi-4-reasoning的基础上进一步迭代,采用强化学习技术,让模型在推理阶段能有效利用更多算力。Token 使用量较Phi-4-reasoning增加了 1.5 倍,实现了更高的准确率。

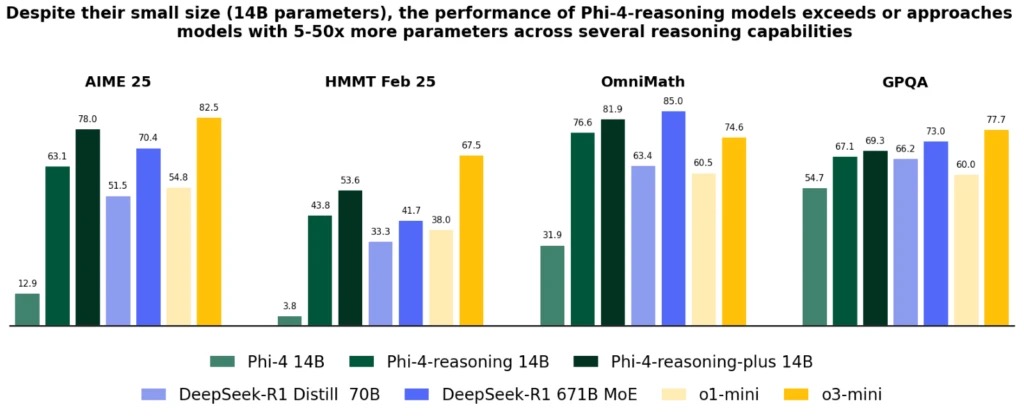

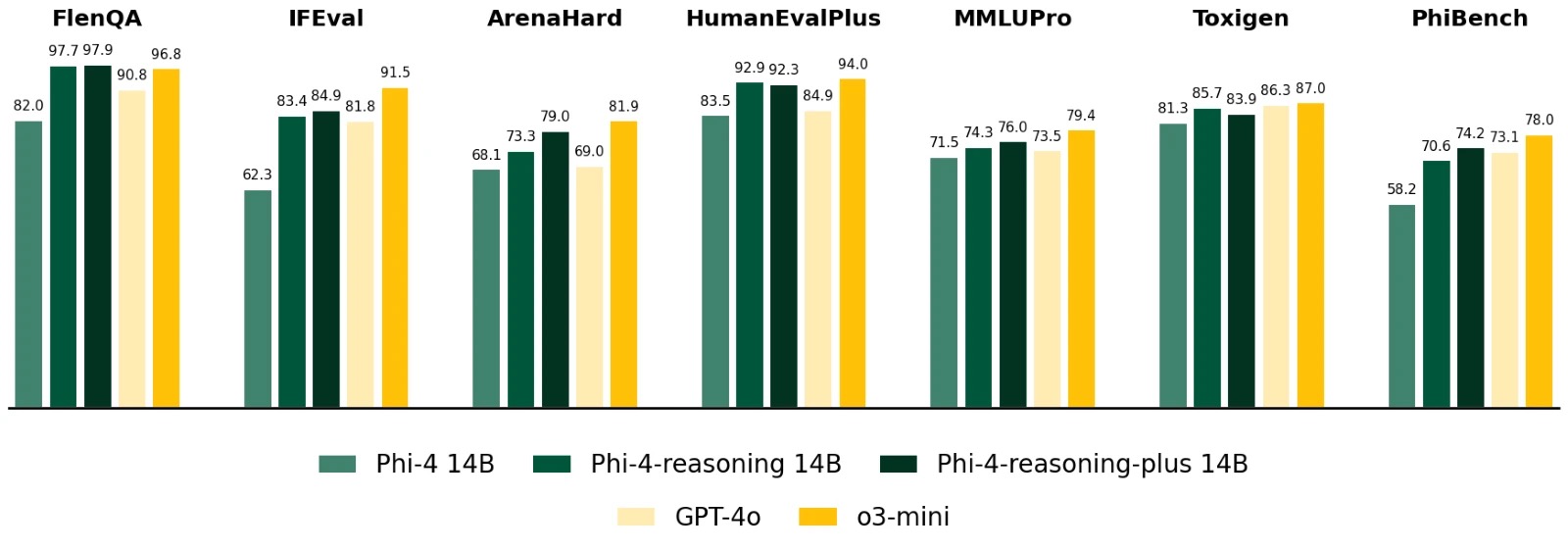

尽管模型参数要远低于同类大模型,但 Phi-4-reasoning 和 plus 版本在多项基准测试中(包括数学推理与博士级别的科学问答)表现优异,成绩要优于 OpenAI o1-mini 和 DeepSeek-R1-Distill-Llama-70B。在 2025 年 AIME 2025(美国数学奥林匹克)测试项目中,其成绩甚至优于拥有 6710 亿参数的满血版 DeepSeek-R1 模型。

目前,这两款模型均已上线 Azure AI Foundry 和 HuggingFace,你可以分别获取及试用 Phi-4-reasoning 和 Phi-4-reasoning-plus。

与 Phi-4 相比,Phi-4-reasoning 系列实现了重大提升。它们不仅超越了 DeepSeek-R1-Distill-70B 等体量更大的模型。在数学、编程、算法推理、规划等多方面能力上,也正逐步逼近甚至赶超 DeepSeek-R1。

详细的定量成果已在技术报告中发布,展示了各类推理任务下的突出表现。

Phi-4-mini-reasoning

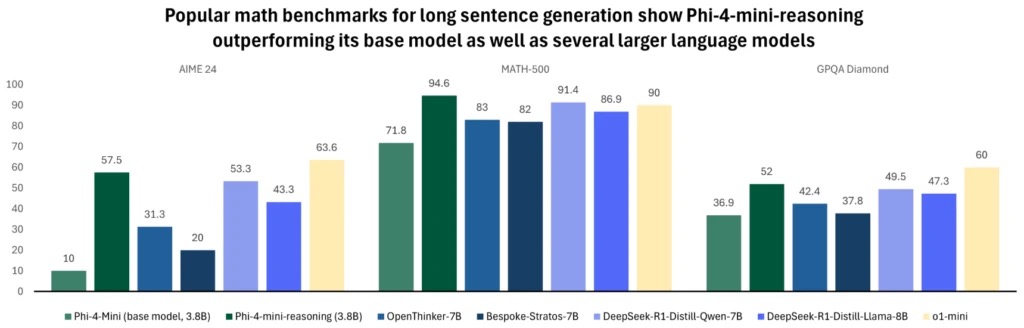

Phi-4-mini-reasoning 专为对「小巧推理模型」有需求的场景而设计。这款基于 Transformer 架构的模型针对数学推理进行了专项优化,能够在受限算力或低延迟环境中,高质量地逐步解决问题。

模型微调阶段大量采用了 DeepSeek-R1 生成的合成数据,既保障了推理能力,又兼顾了推理效率。它非常适合教育领域、嵌入式辅导应用,以及需要轻量级部署的终端与移动场景。

Phi-4-mini-reasoning 覆盖了从初中到博士各个难度级别,累计训练超 100 万道多元化数学题目。你可以前往 Azure AI Foundry 或 HuggingFace 在线体验。

欢迎查阅技术报告,了解更多模型详细数据与分析。

Phi 推理模型的实际应用

在过去一年里,Phi 系列持续推动着小模型、高质量的平衡,不断拓展家族功能,以满足不同场景的需求。如今,这些模型已经可以在 Windows 11 设备的 CPU 与 GPU 上本地运行,方便高效。

随着 Windows 致力于打造新一代个人电脑,Phi 模型已经成为 Copilot+ PC 的核心 AI 引擎之一,并推出了专为 NPU 优化的 Phi Silica 版本:

- 该版本配合操作系统深度管理,可以在内存中预加载,首个 Token 响应极快,吞吐高效还极为省电,能够实现与多种应用的并发调用。

- Phi Silica 已广泛应用于 Click to Do 等核心 Windows 功能,能够为屏幕上的任意内容提供实用的文本智能工具。

- 同时,开发者 API 也已开放,方便进行应用集成。目前,已经有包括 Outlook 在内的多款生产力应用,离线调用 Copilot 摘要等功能。

小巧而强大的 Phi 模型已被优化整合到 PC 生态的多类应用当中。Phi-4-reasoning和Phi-4-mini-reasoning也正借助 Phi Silica 的低比特优化方案,即将在 Copilot+ PC 的 NPU 上全面支持本地运行。

微软负责任的 AI 实践

在微软,践行「负责任 AI 」始终是研发与部署 AI 的核心理念。Phi 模型的开发严格遵循微软 AI 的 6 大原则——责任、透明、公平、可靠与安全、隐私与安全、包容。

Phi 全系列采用了多元化与系统性的安全后训练方案,涵盖了有监督微调(SFT)、直接偏好优化(DPO)及基于人类反馈的强化学习(RLHF)。训练数据既包含公开可用的、专注于有用性与无害性的问答数据集,也涵盖了各类与安全相关的问题与解答。

总的来说,Phi-4 推理模型的发布标志着小型语言模型在人工智能领域的又一重要里程碑。这些模型不仅在性能上取得了显著突破,还拓宽了 AI 技术在各种实际场景中的应用可能性。

最新评论

现在可以了

32位 Windows 版本,没毛病

32位下好后右键属性一看版本型号、安装包信息都TM是64位的

不错,还非常贴心的附上了下载链接。